Prompt Relay: Endelig presis tidsstyring i AI-video

En av de hardeste nøttene å knekke i AI-video har ikke vært bildekvalitet – det har vært kontroll. Å fortelle modellen når noe skal skje, ikke bare hva som skal skje. Prompt Relay løser akkurat det.

Problemet det løser

Tradisjonelle videomodeller sliter med å forstå timing i lengre sekvenser. De vet hva de skal vise, men ikke når handlingen skal starte, eskalere eller avslutte. Resultatet er videoer som føles tilfeldige fremfor regisserte.

Slik fungerer det

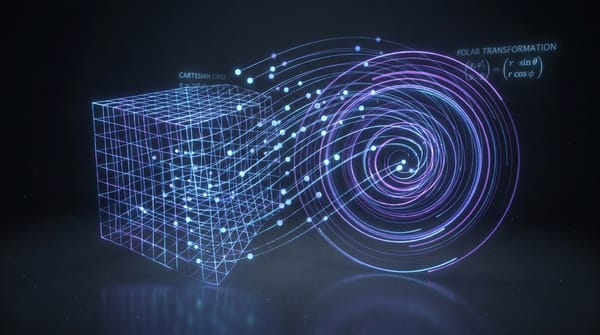

Prompt Relay manipulerer modellens cross-attention-lag under selve genereringen – ikke i trening. Du definerer tidsvinduer for hvert prompt:

- "mannen går" aktivt fra 0 til 2 sekunder

- "mannen begynner å løpe" aktivt fra 2 til 5 sekunder

Mellom segmentene brukes gradvis utfasing i stedet for harde kutt. Modellen plukker opp neste instruksjon sømløst, uten visuelle hopp eller brudd i bevegelse.

Ingen ny trening nødvendig

Det teknisk revolusjonerende er at dette er en inference-time-metode. Eksisterende modeller kan bruke teknikken uten å trenes på nytt – ingen ekstra regnekraft, ingen tilgang til treningsdata. Det gjør Prompt Relay tilgjengelig for alle som allerede jobber med åpne modeller.

Allerede i bruk

Teknikken er integrert i Wan 2.2, kjent for presis håndtering av komplekse bevegelser. Den samme logikken preger også kommersielle verktøy som Kling og Luma Dream Machine – og setter en ny standard for hva én sammenhengende tagning faktisk kan inneholde.

Kontroll er det nye kvalitetsmålet

Prompt Relay flytter AI-video fra «generer og håp» til regissert historiefortelling. For skapere som vil fortelle komplekse historier uten klipp, er dette den manglende brikken.

Ressurser: Prompt Relay – GitHub · Wan Video · Luma Labs · Kling AI